Por Roberta Fagundes

Os últimos anos têm sido marcados por um avanço fenomenal da Internet e da Inteligência Artificial. O impacto dessas tecnologias no mundo dos negócios e do comércio vai desde a possibilidade de comprar praticamente qualquer coisa em qualquer lugar do mundo e receber em sua casa, até aplicativos que desempenham a função de experientes secretárias executivas em reuniões complexas e importantes. Hoje, isso parece ser muito natural mas, na verdade, representa uma transformação imensa em relação ao que se conhecia há vinte, trinta anos atrás.

Se com a Internet tornou-se possível visitar virtualmente museus e bibliotecas de vários países, ler livros inteiros e ter acesso às produções mais diversas da indústria cinematográfica e fonográfica mundial, a IA, por sua vez, transformou para sempre a relação do ser humano com o campo do conhecimento. Distâncias foram encurtadas e presença ganhou novo sentido e formato. Existir, em pleno 2025, significa, também, estar presente nas redes sociais, onde a interação desconhece fronteiras nacionais e linguísticas.

Nesse território tão vasto e capaz de impactar as dimensões pessoais e profissionais de qualquer pessoa, a urgência em estabelecer regras claras para o ciberespaço e para os algoritmos não é apenas uma questão de ordem econômica, mas um imperativo democrático para a garantia dos direitos humanos em escala global. O debate é complexo, multifacetado e tem sido confrontado pela velocidade da inovação tecnológica, pelos interesses de grupos poderosos e pela lentidão dos processos legislativos.

O mundo atual tenta equilibrar os riscos e a proteção dos Direitos Fundamentais

A demanda por regulação surge da constatação de que a tecnologia, sem parâmetros éticos e legais, pode se tornar uma ameaça direta aos pilares democráticos da sociedade. A questão é experimentada em todos os continentes do globo: a falta de governança nas grandes plataformas digitais tem sido um fator impulsionador para a disseminação de desinformação, discursos de ódio e a polarização social.

No campo da Inteligência Artificial (IA), o risco está assentado no potencial de viés algorítmico, cujos sistemas, quando não regulados podem amplificar preconceitos sociais, como racismo e sexismo, ao tomar decisões críticas em áreas sensíveis como justiça criminal, concessão de crédito e processos trabalhistas. A regulação, portanto, tem sido considerada como mecanismo para garantir direitos humanos fundamentais, como a não-discriminação e a privacidade no ambiente digital.

A jurista e especialista em Direitos Humanos, Flávia Piovesan, autora de diversos livros sobre esse tema, reforça que os direitos humanos devem atuar como a lente ética e legal que guia o desenvolvimento e a aplicação da IA, da Internet e, em um horizonte emergente, da Neurotecnologia. Essa visão exige que os sistemas de justiça atuem como garantidores ativos de direitos, por meio de mecanismos que assegurem que as regulamentações estejam em consonância com o sistema global de proteção.

A comunidade internacional tem reconhecido essa necessidade. Em março de 2024, a Assembleia Geral da ONU aprovou por consenso uma resolução histórica sobre a governança da IA, enfatizando a necessidade de que o desenvolvimento e o uso da tecnologia estejam alinhados com os direitos humanos, a democracia e o estado de direito. De forma complementar, o Conselho da Europa aprovou em junho de 2024 o primeiro tratado internacional vinculante sobre IA, dedicado explicitamente em assegurar a conformidade com os direitos humanos.

Os três modelos regulatórios que se destacam no mundo

Três grandes blocos geopolíticos lideram, hoje, o desenvolvimento de modelos regulatórios no mundo: a União Europeia, os Estados Unidos e a China.

A União Europeia (UE) se posiciona como a pioneira na regulação da Internet e da IA, mantendo um debate importante sobre a proteção dos direitos fundamentais e a transparência. Suas iniciativas principais são o AI Act (Lei de IA), que categoriza os sistemas de IA por nível de risco (inaceitável, alto, limitado, mínimo), proibindo práticas que ameacem os direitos fundamentais dos cidadãos; e o Digital Services Act (DSA), que estabelece regras de responsabilidade e transparência para as plataformas digitais. A União Europeia, com o AI Act, estabeleceu um marco global ao ser a primeira a adotar uma lei horizontal e abrangente sobre IA, que tem servido de referência para outras jurisdições, como o Brasil, que também debatem sua própria legislação.

Já os Estados Unidos têm priorizado a inovação, a segurança e a competitividade, utilizando predominantemente Ordens Executivas e guias de padrões voluntários. Embora haja uma pressão crescente por uma legislação federal mais robusta, o modelo atual é menos centralizado e mais adaptável a setores específicos, com foco em segurança e concorrência. Portanto, o viés é dar prioridade ao mundo dos negócios.

A China, grande potência econômica e tecnológica, apresenta um modelo estatal e centralizado, tendo como foco principal a estabilidade social, o controle e a inovação. A regulação chinesa se manifesta em regras específicas para algoritmos e conteúdo, com forte ênfase na responsabilidade dos provedores de tecnologia e no controle rigoroso do conteúdo digital, refletindo o modelo de governança centralizada do país.

Apesar do consenso sobre a necessidade de regulação, o caminho é repleto de obstáculos

O principal desafio para a regulação da Internet e da IA é o descompasso entre o ritmo da tecnologia e o tempo da lei. Modernizar a legislação, por sua natureza, é um processo lento, com risco de se tornar obsoleta rapidamente diante de novas gerações de modelos de IA.

Não é só isso. A internet e a IA operam em escala global, muitas vezes, rompendo fronteiras tradicionais. Mas as leis são territoriais. Essa característica cria um complexo mosaico regulatório, dificultando a aplicação uniforme das regras e permitindo que empresas explorem as jurisdições mais permissivas.

É nesse ambiente que tem ocorrido um constante debate sobre como criar um ordenamento jurídico que proteja os cidadãos sem sufocar a inovação. Críticos argumentam que a regulação excessiva pode desincentivar o desenvolvimento de novas tecnologias, enquanto defensores da regulação afirmam que a inovação irresponsável é inevitavelmente prejudicial.

No âmbito da internet, a garantia da Neutralidade de Rede, prevista pelo artigo 9º da Lei nº 12.965/2014 — o princípio de que todo o tráfego de dados deve ser tratado de forma igual pelos provedores, como estabelece o Marco Civil da Internet brasileiro — permanece um desafio constante contra a tentação de priorização de conteúdo. Na prática, a Lei busca garantir que o provedor não dê preferência (mais velocidade ou acesso facilitado) a um site em detrimento de outro. Além disso, a definição de responsabilidade legal por danos causados por sistemas de IA autônomos ou desinformação algorítmica ainda carece de regulamentação jurídica.

O Brasil está na vanguarda da regulamentação

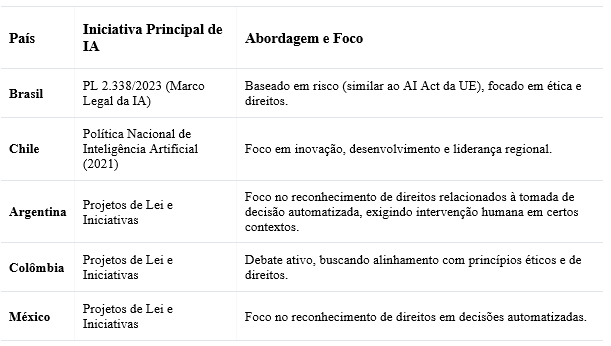

O Brasil, com o histórico Marco Civil da Internet (MCI), Lei nº 12.965/2014, é considerado um pioneiro em legislação digital no mundo, liderando, atualmente, a discussão regional com dois projetos de lei que moldarão o futuro digital: o Marco Legal da IA e a regulação das plataformas digitais.

O Projeto de Lei 2.338/2023, que visa estabelecer o Marco Legal da Inteligência Artificial no Brasil, é a principal iniciativa do país. Ele foi aprovado pelo Senado Federal em dezembro de 2024 e, atualmente, está em análise na Câmara dos Deputados.

O texto é fortemente influenciado pelo AI Act da União Europeia, adotando um modelo baseado em risco. O projeto categoriza os sistemas de IA e impõe obrigações proporcionais ao potencial de dano, com o objetivo de garantir que o desenvolvimento e o uso da tecnologia sejam éticos, seguros e alinhados aos direitos fundamentais. O debate no Congresso envolve a busca por um equilíbrio entre a proteção dos cidadãos e a promoção da inovação, com discussões sobre a centralização da fiscalização e a defesa do Plano Brasileiro de Inteligência Artificial (PBIA).

Em paralelo, o debate sobre a regulação das grandes plataformas digitais, centralizado no Projeto de Lei 2.630/2020, conhecido como “PL das Fake News”, enfrenta um momento de impasse.

O projeto busca alterar o Marco Civil da Internet para estabelecer normas de transparência, responsabilidade e combate à desinformação por parte dos provedores de redes sociais. No entanto, o avanço da proposta na Câmara dos Deputados foi paralisado em meados de 2024, em meio a intensas controvérsias sobre a responsabilidade presumida dos provedores por conteúdo ilícito e a proposta de taxação das plataformas.

A interconexão entre os dois temas é evidente: a IA é o motor algorítmico que impulsiona a desinformação e a polarização nas redes sociais. Portanto, a regulação das plataformas digitais e da IA são vistas como essenciais para a defesa da democracia e dos direitos humanos no país.

Esse mesmo debate regulatório se estende por toda a América do Sul, com países buscando modelos próprios ou adaptando referências internacionais. Há um consenso regional sobre a necessidade de quadros normativos para a governança da IA e das plataformas digitais, com a Comissão Econômica para a América Latina e o Caribe (CEPAL) buscando uma abordagem coordenada através do grupo de trabalho e-LAC.

O Índice Latino-Americano de Inteligência Artificial (ILIA) destaca o Brasil, o Chile e o Uruguai como líderes regionais em termos de preparo e avanço nesse debate.

É importante compreender a interconexão Internet e IA

Entender que a regulação da IA e a regulação das plataformas digitais (internet) são faces da mesma moeda é o primeiro passo para acompanhar a discussão mundial sobre o tema. As grandes plataformas são, hoje, as principais desenvolvedoras e disseminadoras de sistemas de IA, e a IA é o motor que impulsiona a desinformação e a polarização nas redes sociais.

A governança da internet, construída sobre princípios multissetoriais e baseada na liberdade de expressão e nos direitos humanos – como defendido pelo Comitê Gestor da Internet no Brasil, CGI.br –, serve como um ponto de partida ético para a discussão sobre a IA. A regulação futura deve, portanto, abordar a intersecção entre plataformas e algoritmos, garantindo que a transparência e a responsabilidade algorítmica sejam tão fundamentais quanto a liberdade de expressão.

A regulação da internet e da IA não deve ser vista como um entrave ao progresso, mas sim como um investimento na confiança e na segurança digital. Ao estabelecer limites éticos e legais, a sociedade garante que a próxima onda de inovação tecnológica sirva para fortalecer, e não para minar, os direitos humanos e as instituições democráticas em todo o mundo.