Por Roberta Fagundes

Sancionado como Lei nº 15.211/2025 e regulamentado pelo Decreto nº 12.880/2026, o Estatuto da Criança e do Adolescente (ECA) Digital nasce como resposta a riscos reais enfrentados por crianças e adolescentes na Internet – mas também como peça de uma disputa maior: quem define as regras da vida digital, o Estado, as famílias ou as plataformas globais?

Segundo pesquisas do Comitê Gestor da Internet no Brasil, 93% dos brasileiros entre 9 e 17 anos utilizam internet regularmente. Entre os adolescentes, o uso de redes sociais ultrapassa 80%.

O levantamento TIC Kids Online Brasil revela que o primeiro contato com smartphones ocorre cada vez mais cedo, antes mesmo dos 10 anos. Em muitos lares brasileiros, o celular se tornou a principal porta de entrada para entretenimento, socialização e informação. E é nessa ordem mesmo. Significa que grande parte da infância contemporânea acontece em ambientes digitais governados por sistemas automatizados.

Diferente da televisão ou do rádio (que são meios de comunicação tradicionais, centralizados e relativamente previsíveis), as plataformas digitais funcionam com base em algoritmos de recomendação. Esses sistemas analisam o comportamento do usuário e selecionam conteúdos com base em probabilidades de engajamento. Funciona assim: quanto mais tempo uma pessoa permanece na plataforma, mais dados são coletados e mais preciso se torna o modelo de recomendação. Esse mecanismo é a base do modelo econômico das grandes plataformas digitais.

Imagine a cena: no início de uma manhã comum nas diversas cidades brasileiras, milhões de crianças pegam seus celulares antes mesmo de sair da cama. Enquanto umas assistem a vídeos curtos no TikTok; outras respondem mensagens no WhatsApp. Outras ainda percorrem rapidamente os conteúdos do Instagram ou passam alguns minutos no YouTube. Para essa geração, a internet é um ambiente tão natural que, simplesmente, é onde parte da vida “real” acontece.

Aparentemente, deslizar o dedo na tela de um dispositivo eletrônico é um gesto banal. Ledo engano. Os algoritmos registram cada movimento, armazenam dados e analisam padrões de comportamento, reorganizando o fluxo de conteúdos que aparecerá, de forma muito personalizada, nos próximos segundos, com o objetivo de capturar atenção, coletar dados e maximizar tempo de permanência. Esse fenômeno colocou o Brasil diante de uma pergunta desafiadora: como proteger a infância em um “mundo governado” por algoritmos?

No dia 9 de agosto de 2025, o influenciador Felipe Bressanin, o Felca, publicou um vídeo denunciando a exploração de pessoas menores de 18 anos e a exposição infantil nas redes. Segundo a Secretaria de Comunicação Social da Presidência da República (Secom), o material alcançou quase 50 milhões de visualizações, contribuindo para transformar um tema técnico em assunto prioritário da nação. Dias depois, o PL 2.628/2022 ganhou impulso e velocidade no Congresso Nacional, passando a ser apresentado, em Brasília, como teste moral da República diante do poder das plataformas digitais.

O marco desse processo foi a assinatura dos decretos relacionados ao ECA Digital, pelo presidente Luiz Inácio Lula da Silva, em 18 de março de 2026, na presença de representantes da Agência Nacional de Proteção de Dados (ANPD), da Secom da Presidência da República, e do Ministério da Justiça e Segurança Pública (MJSP). A mensagem institucional foi clara: a Internet deixaria de ser regulada apenas pelo contrato privado das empresas e pela reação posterior do Poder Judiciário; e passaria a ser enquadrada também por um regime de proteção integral da infância, desenhado em linguagem de risco, deveres de cuidado, verificação etária, governança de dados e efetiva responsabilização.

Mas, enfim, o ECA Digital é uma política pública de proteção da infância ou um novo capítulo da disputa global entre Estados e plataformas digitais pelo controle da internet? Ele é as duas coisas. Sem dúvida, em sua base normativa, o estatuto é uma lei de proteção da infância. Mas, em sua mecânica institucional e econômica, ele também funciona como instrumento de soberania regulatória diante de empresas que operam transnacionalmente, definem padrões privados de moderação, monetizam atenção infantil e resistem a dar transparência à sua real arquitetura para o acompanhamento estatal e social. Portanto, o Brasil inovou ao estabelecer a fusão dessas duas dimensões.

O país não importou intacto o modelo europeu, nem reproduziu a tradição anglo-saxã de “dever de cuidado” na versão tropical. O que emergiu foi um arranjo híbrido: a gramática constitucional do artigo 227, que estabelece como dever da família, da sociedade e do Estado garantir a crianças, adolescentes e jovens, com absoluta prioridade, o que inclui a proteção contra negligência, discriminação, exploração, violência, crueldade e opressão; a doutrina da proteção integral do Estatuto da Criança e do Adolescente (ECA); a infraestrutura de direitos da Lei Geral de Proteção de Dados (LGPD); a herança disputada do Marco Civil da Internet e uma nova camada de comando administrativo entregue à ANPD.

O ECA Digital amadureceu no choque

Da apresentação do PL 2.628/2022, em 18 de outubro de 2022, pelo senador Alessandro Vieira, então no PSDB de Sergipe, com ementa simples e ampla, dispondo sobre a proteção de crianças e adolescentes em ambientes digitais; a proposta passou pela Comissão de Direitos Humanos, pela Comissão de Constituição e Justiça e, depois de redespacho, pela Comissão de Comunicação e Direito Digital, onde recebeu emendas, substitutivos e negociações que alteraram sua fisionomia.

A audiência pública da Comissão de Comunicação e Direito Digital (CCDD) de 14 de maio de 2024 ajuda a entender essa incubação. O Senado reuniu, numa mesma sala, representantes da ANPD, do Ministério da Justiça, da SaferNet Brasil, do Instituto Alana, do Data Privacy Brasil, do Conselho Digital do Brasil, da Associação Brasileira das Desenvolvedoras de Jogos Eletrônicos, da Associação Brasileira de Anunciantes, acadêmicos e representantes de famílias. Esse processo revela que a lei, desde o início, foi formatada como campo de disputa entre, pelo menos, quatro agendas: direitos da criança, proteção de dados, liberdade empresarial e mercado de publicidade e entretenimento digital.

A tramitação formal do Projeto de Lei confirma a densidade desse embate. Em 23 de fevereiro de 2024, a CCJ aprovou substitutivo. Em 28 de novembro de 2024, a CCDD adotou texto terminativo com acolhimento total ou parcial de parte das emendas e rejeição de outras. Encerrado o prazo recursal, o projeto seguiu para a Câmara dos Deputados. Ali, o texto foi alterado. Em agosto de 2025, a Câmara aprovou substitutivo; dias depois, o Senado voltou a apreciar a matéria e a converteu em norma jurídica.

Foi nesse intervalo que a política saiu dos autos e ocupou o centro do palco. A Secom registrou que o governo tratou a aprovação na Câmara como vitória de uma coalizão “multiministerial”, envolvendo Ministério dos Direitos Humanos e da Cidadania, Ministério da Justiça, ANPD, Secom, Ministério das Mulheres e Ministério da Igualdade Racial, entre outros órgãos. A ministra dos Direitos Humanos e da Cidadania, Macaé Evaristo, e o Secretário de Politicas Digitais da SECOM/Presidência, João Brant, foram vozes públicas desse esforço. O governo enquadrou o projeto como resposta institucional à incapacidade das plataformas de autorregular a proteção infantil.

O Senado, por sua vez, consolidou a narrativa de que a lei era resposta à “adultização” de menores nas plataformas e lembrou que parte da oposição a via como abertura para uma regulação mais dura das redes sociais. O discurso da proteção derrotou a ala mais conservadora do Senado, que buscava evitar a regulação, afirmando que, depois de aberta a “porteira”, o controle das redes não se fecharia mais. A preocupação da ala mais conservadora tem endereço certo: Fake News, discursos de ódio e as disputas eleitorais de 2026.

Nos bastidores, um consórcio de Estado contra o atraso regulatório

A consolidação da Lei nº 15.211/2025 assumiu contornos ainda mais amplos: um “consórcio de Estado” em torno da tese de que a infância digital não poderia continuar subordinada ao arranjo voluntarista das plataformas. Isso ganhou força no Decreto nº 12.880/2026 que, além de detalhar a lei, instituiu a Política Nacional de Promoção e Proteção dos Direitos da Criança e do Adolescente no Ambiente Digital, autorizando a criação do Centro Nacional de Triagem de Notificações. O texto confere à ANPD competência para regulamentar e fiscalizar a lei, sem prejuízo das atribuições de outros órgãos do sistema de garantia de direitos. Esse é o ponto.

O Brasil está tratando a proteção infantil on-line não apenas como problema de segurança pública ou conteúdo ilícito, mas como questão estrutural de governança de dados, arquitetura de produto e assimetria informacional. É uma opção diferente, por exemplo, da centralidade atribuída à Ofcom no Reino Unido ou da lógica distribuída do DSA europeu, ainda que dialogue com ambos os modelos.

Na arena política, sente-se a tensão do lobby empresarial. Reportagem da Tech Policy Press sustenta que big techs passaram anos defendendo diante do governo brasileiro a ideia de que a segurança infantil seria responsabilidade primária das famílias e relata que o Conselho Digital (organização financiada pela Meta, TikTok, X e Google) participou do debate com esse enquadramento. A mesma reportagem afirma que metadados de emendas apresentadas por parlamentares de direita brasileira indicariam redação por lobista da Meta em ao menos dois casos, um voltado a reduzir obrigações de transparência e outro a enfraquecer sanções. Ainda que essas alegações não constem de documento oficial primário, o simples fato de que elas surgem com verossimilhança jornalística já revela onde estava o eixo da disputa: não na existência abstrata de proteção à infância, mas na extensão concreta da responsabilidade corporativa.

A Human Rights Watch, organização internacional não governamental que defende e realiza pesquisas sobre os direitos humanos, vai na mesma direção ao afirmar que a passagem da lei refletiu “forte vontade política”, apesar de “fierce opposition from tech companies” (forte oposição das empresas de tecnologia), e que partes do texto original foram enfraquecidas durante a tramitação, embora a proibição das loot boxes (caixa de recompensa que se trata de uma mecânica de microtransações inseridas em jogos eletrônicos) tenha sido reinserida no Senado após ter sido retirada na Câmara dos Deputados. Esse episódio mostra que o texto final do ECA Digital foi menos produto de consenso e mais resultado de uma sequência de avanços, recuos e recomposições entre Congresso, Executivo, sociedade civil e setor privado.

Quando o ECA encontra a internet real

Do ponto de vista normativo, a Lei nº 15.211/2025 é sofisticada porque não substitui o ECA, o Marco Civil ou a LGPD, mas constrói uma nova camada por cima deles. O artigo 3º explicita que os produtos e serviços de tecnologia direcionados a crianças e adolescentes, ou de acesso provável por eles, devem assegurar proteção prioritária, melhor interesse e elevado nível de privacidade, proteção de dados e segurança, “nos termos” do ECA e da LGPD. A lei, portanto, não cria um universo paralelo; ela reorganiza o ecossistema jurídico existente em torno da infância digital.

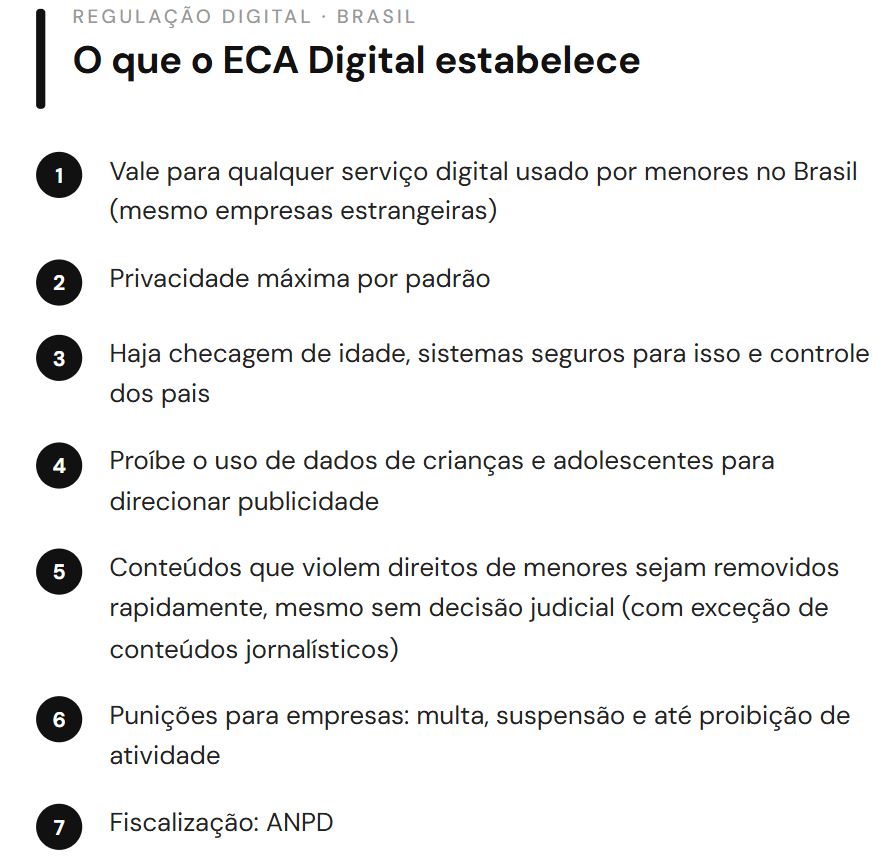

Sua inovação mais forte está em deslocar a regulação do plano exclusivamente repressivo para o plano do desenho do produto. O artigo 6º impõe medidas razoáveis, desde a concepção e ao longo da operação, para prevenir e mitigar riscos de acesso, exposição, recomendação ou facilitação de contato com conteúdo relacionado a exploração sexual, violência, automutilação, drogas, jogos de azar e pornografia, dentre outros. O artigo 7º exige o padrão mais protetivo disponível em privacidade e proteção de dados. O artigo 22 proíbe técnicas de perfilamento para direcionamento de publicidade comercial a crianças e adolescentes. O artigo 26 veda a criação de perfis comportamentais de menores, inclusive a partir de dados coletados em processos de verificação etária, para fins publicitários.

Em outras palavras, o ECA Digital não se limita a dizer “remova conteúdo ilegal”. Ele intervém em mecanismos que sustentam o negócio digital contemporâneo: recomendação algorítmica, captação de atenção, personalização comercial e coleta de dados comportamentais. É aí que a lei deixa de ser apenas um estatuto protetivo e passa a tocar o coração do capitalismo de plataforma, com zonas de atrito.

A primeira é a verificação de idade, prevista no artigo 9º, que determina mecanismos confiáveis de verificação de idade para acesso a conteúdo impróprio ou inadequado, vedando a autodeclaração. O decreto acrescenta definições de “aferição de idade”, “verificação de idade”, “sinal de idade” e “autodeclaração”, além de prever atuação do poder público como regulador, certificador ou promotor de soluções técnicas, com participação social. Se o avanço é inegável, o risco também é. Quanto mais robusto for o controle etário, maior a pressão sobre coleta de atributos sensíveis, biometria, documentação e rastros persistentes. A lei tenta evitar esse desvio ao exigir minimização de dados e uso exclusivo para a finalidade etária, mas a tensão entre proteção e privacidade está embutida no próprio mecanismo.

A segunda zona de atrito é a responsabilização por remoção de conteúdo, disposta no artigo 29, que manda retirar conteúdos violadores de direitos de crianças e adolescentes assim que o fornecedor for comunicado pela vítima, por representantes, pelo Ministério Público ou por entidades representativas, independentemente de ordem judicial, embora exclua conteúdos jornalísticos e submetidos a controle editorial. A intenção é proteger vítimas com mais rapidez, mas colide com a dificuldade jurídica desse regime, que se insere numa tradição brasileira marcada pela cautela do Marco Civil da Internet em relação à remoção privada, especialmente para evitar censura indevida. O quadro se torna ainda mais complexo num ambiente em que o STF discute o alcance da responsabilidade das plataformas sob o artigo 19 do Marco Civil da Internet. Análise jurídica publicada em fevereiro de 2026 por escritório especializado descreve que a Suprema Corte caminhou para um modelo mais preventivo e diligente de responsabilidade, aproximando o país de regimes como o Digital Services Act (DSA) europeu. Ainda que esse diagnóstico não substitua a leitura direta dos autos, ele mostra que o ECA Digital entrou em vigor num momento de reconfiguração constitucional mais ampla do papel das plataformas no Brasil.

A terceira zona de atrito é institucional. A lei fala em “autoridade administrativa autônoma de proteção dos direitos de crianças e de adolescentes no ambiente digital”, mas o decreto atribui à ANPD a regulamentação e a fiscalização. Isso resolve temporariamente o problema do comando, mas deixa em aberto questões sobre capacidade, orçamento, interoperabilidade com conselhos tutelares, Ministério Público, Senacon, Ministério da Justiça e Segurança Pública e órgãos de classificação indicativa. O desafio está posto: a engrenagem existe no papel; mas sua articulação ainda é promessa administrativa.

Quem paga a conta

O impacto econômico do ECA Digital decorre menos das multas máximas e mais do redesenho estrutural que ele exige. Multas de até 10% do faturamento do grupo econômico no Brasil chamam atenção, mas o custo real está na engenharia de produto, na certificação etária, na integração entre sistemas operacionais e aplicativos, na adaptação de sistemas de anúncios, na revisão de recomendações automatizadas, na produção de relatórios semestrais, nos canais de denúncia, nas equipes de moderação, na representação legal no país e na documentação permanente de diligência.

Para grandes plataformas, isso significa erosão de uma vantagem histórica: oferecer o mesmo produto global com pequenas variações locais. A lei brasileira dificulta essa padronização porque atinge três áreas particularmente sensíveis ao modelo de negócios. A primeira delas é a publicidade comportamental, ao proibir perfilamento comercial de menores. A segunda é a retenção de atenção, já que a supervisão parental e o desenho protetivo reduzem a liberdade de experimentar recursos persuasivos sem salvaguardas. A terceira é a descentralização de responsabilidades, pois a lei distribui deveres por toda a cadeia: redes sociais, apps, lojas de aplicativos e sistemas operacionais.

No caso do Google, a resposta pública encontrada nas fontes acessadas é adaptativa. Em página jurídica específica sobre o ECA Digital, a empresa afirma estar comprometida com os objetivos da lei e descreve mecanismos de detecção automatizada e humana, ferramentas de denúncia, políticas de segurança, recursos do Google Families e restrições etárias já existentes. O tom não é de confronto, mas de absorção regulatória: apresentar o cumprimento da lei como extensão de práticas preexistentes.

A Meta adotou estratégia semelhante no plano reputacional. Em janeiro de 2026, publicou texto institucional destacando a expansão das Teen Accounts para Facebook e Messenger, contas privadas por padrão, limites de tempo, controles parentais e endurecimento das configurações de conteúdo para adolescentes. O texto não menciona diretamente o ECA Digital, mas opera como sinal político, enviando a mensagem de que a companhia quer mostrar que já vem se ajustando aos novos padrões protetivos internacionais, menos liberdade total de design e maior mediação parental.

A Apple, por sua vez, oferece talvez o exemplo mais direto de reação pública ao efeito extraterritorial da lei brasileira. Em nota a desenvolvedores publicada em 24 de fevereiro de 2026, a empresa informou que apps distribuídos no Brasil poderiam usar a Declared Age Range API para obter categoria etária do usuário e que, a partir daquela data, usuários no Brasil, na Austrália e em Singapura seriam bloqueados de baixar aplicativos classificados como 18+ sem confirmação razoável de que são adultos. A mesma nota afirma que apps com loot boxes identificadas no questionário de classificação etária seriam ajustadas para 18+ na loja brasileira. Trata-se de um dado importante porque mostra, de modo verificável, como uma lei nacional força ajustes operacionais em infraestruturas globais de distribuição de software.

No caso do TikTok, a empresa aparece, segundo a Tech Policy Press, entre as financiadoras do Conselho Digital, organização que sustentou no debate público uma ênfase maior no papel das famílias e menor na imputação direta de culpa às plataformas. A ausência de pronunciamento específico, nesse contexto, deixa transparecer que a disputa pode estar se dando na arena técnico-política do lobby, da regulação infralegal e das coalizões setoriais.

Se, por um lado, a lei tenta aliviar o peso regulatório sobre empresas menores ao prever regras proporcionais ao risco e ao porte; por outro, o custo de entrada aumenta. Na prática, cumprir as exigências legais demanda tecnologia, estrutura e investimento, recursos que estão concentrados nas grandes plataformas. O efeito disso, ao mesmo tempo em que busca conter o poder das big techs, pode reforçar a vantagem de quem já domina o mercado.

Afinal, o Brasil está copiando a Europa? Não exatamente.

O debate internacional ajuda a entender melhor o que é, de fato, o ECA Digital. A Comissão Europeia afirma que o Digital Services Act (DSA) exige que plataformas acessíveis a crianças e adolescentes assegurem elevado nível de privacidade, segurança e proteção, além de restringir a publicidade direcionada com base em perfilamento de dados. As diretrizes voltadas à proteção de menores reforçam princípios como design e privacidade por padrão, enquanto a União Europeia avança na construção de soluções harmonizadas de verificação etária com preservação da privacidade. Já o Reino Unido estrutura o Online Safety Act 2023 como um regime baseado em deveres de segurança, avaliações de risco, códigos regulatórios, exigências proporcionais e fiscalização por um regulador independente, a Ofcom.

O Brasil converge com esses modelos em pelo menos três pontos. Primeiro, abandona a ficção de neutralidade de design e admite que arquiteturas digitais produzem risco. Segundo, desloca o foco do conteúdo isolado para sistemas, processos e deveres permanentes de diligência. E, por último, amplia o alcance territorial da regulação sobre empresas globais que ofertam serviços a usuários locais.

Mas o ECA Digital ainda vai além disso, porque ele está ancorado na doutrina da proteção integral da infância, herança constitucional e estatutária muito mais forte do que a linguagem europeia de mercado digital ou a britânica de dever de cuidado. A lei incorpora elementos tipicamente brasileiros: vinculação de contas de menores de até 16 anos a responsáveis, proibição expressa de loot boxes para públicos infantojuvenis, destinação do debate à ANPD e uma articulação explícita com o ECA, a LGPD, a Política Nacional de Educação Digital e o sistema de garantia de direitos.

Sem dúvida, o Brasil adicionou a esse assunto uma tradição de direitos da criança e um impulso de soberania jurídica sobre a infraestrutura global de plataformas. Não é pouca coisa. Em um mundo no qual, segundo a Tech Policy Press, ao menos 42 países discutem ou já aprovaram medidas de restrição etária para redes sociais, o ECA Digital posiciona o país na linha de frente da disputa sobre quem governará a infância conectada.

Não existe mais política infantil puramente pedagógica ou familiar quando a experiência cotidiana de crianças e adolescentes é organizada por sistemas de recomendação, mercados de dados, lojas de aplicativos, jogos de recompensa e plataformas de vídeo operadas por conglomerados globais. O que o ECA Digital faz é transformar essa constatação em norma.

Mas o desafio não está vencido com o marco regulatório. Seu sucesso dependerá da capacidade de o Estado produzir regulação infralegal tecnicamente robusta, auditável, proporcional e compatível com a privacidade; resistir ao lobby sem demonizar toda inovação; distinguir risco real de pânico moral; e proteger crianças sem naturalizar vigilância massiva ou censura difusa. A própria lei parece saber disso quando proíbe que sua regulamentação resulte em mecanismos de vigilância massiva, genérica ou indiscriminada.

A lei já venceu a batalha simbólica. A batalha material, a que envolve orçamento, tecnologia, lobby, burocracia e direitos fundamentais, apenas começou.